เมื่อวานนี้ (28 พ.ย.) ผมได้มีโอกาสไปร่วมงาน SIGGRAPH Asia 2017 ที่เป็นเหมือนงานลูกของ SIGGRAPH ที่ย่อยลงมาในสเกลของระดับเอเชียครับ ผมเชื่อว่าใครเป็นสาย geek จ๋าน่าจะพอรู้กันบ้างแหละว่างานนี้เป็นงานแนวไหน แต่ก็ขออธิบายให้กับคนที่ไม่รู้จักด้วยละกัน งาน SIGGRAPH นั้นเป็นงานสาย Computer Graphics ที่เปิดให้กลุ่มคนในวงการมาแสดงผลงานวิจัย, โชว์ผลิตภัณฑ์หรือผลงานของแต่ละบริษัท รวมไปถึงการแสดงผลงานศิลปะที่ใช้งานนำเสนอด้วยกลไก, การประมวลผลของคอมพิวเตอร์มาร่วม หรือผลงานเชิงปฏิสัมพันธ์ (Interactive) ด้วย

ภายในงานมีการจำหน่ายตั๋วเข้าชมหลายระดับครับ แต่ตั๋วแพงๆ คือจะเป็นในส่วนของคนที่เข้าฟัง Conference ที่นักวิจัยมาอธิบายผลงานให้ผู้สนใจเข้าฟัง (ตั๋วหมื่นบาท ++) แต่สำหรับผุ้สนใจไปดูความเป็นไปของวงการนี้ก็สามารถเลือกตั๋วที่เรียกว่า Experience Pass ได้ครับ ราคาอยู่ที่ประมาณ $30 หรือราวพันบาทครับ จะเข้าชมได้ในส่วน Exhibition, Emerging Technologies และ Art Gallery

งาน SIGGRAPH Asia 2017 นั้นมีการประชุมงานวางแผนล่วงหน้ามาถึง 3 ปีครับ โดยประชุมวิดีโอคอลล์กันมาตลอด ทีมงานก็มีหลากหลายชาติมาก โดยในการจัดที่กรุงเทพฯ ครั้งนี้มีหัวหอกคือ ผู้ช่วยศาสตราจารย์ ดร. สุรพงษ์ เลิศสิทธิชัย และยังมีคณะกรรมการอีกหลายคนประสานงานกันด้วยครับ

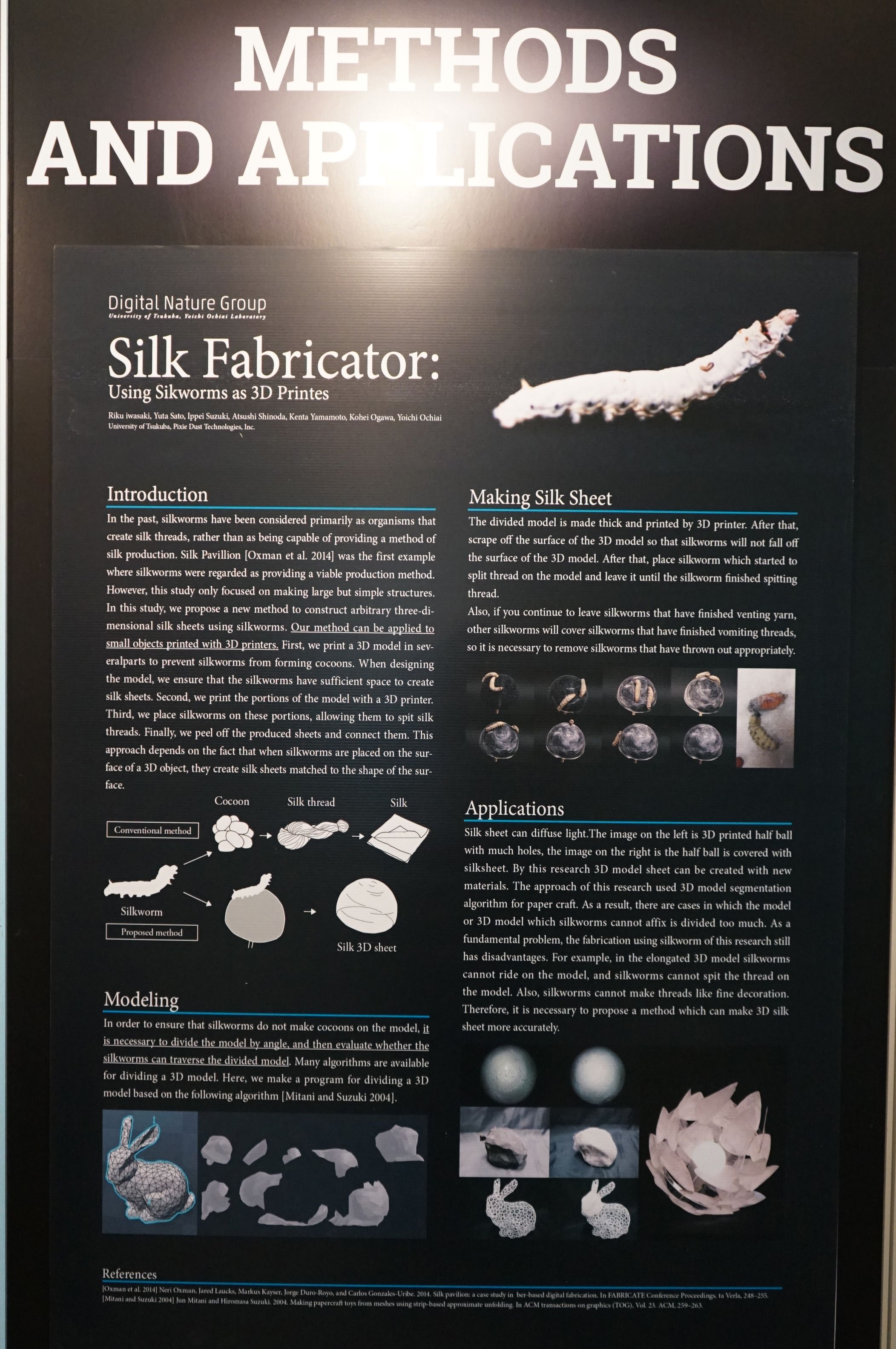

จากบริเวณลงทะเบียน ข้างๆ จะมีบอร์ดที่แปะผลงานวิจัยของมหาวิทยาลัยต่างๆ มาโชว์อยู่ครับ มีหลายตัวที่เข้าใจได้ไม่ยากและน่าสนใจ เช่น งานนึงของ LG อันนี้เข้าใจว่ายังเป็นแค่การนำเสนอไอเดียครับ เป็นคีย์บอร์ดที่สามารถยุบปุ่มลงได้และเปลี่ยนสี เมื่อดึงปากกาด้านข้างออกมา พื้นที่ที่ได้มาจากการยุบของปุ่มจะใช้เป็นที่เขียนโน้ตได้ หรืออีกอันหนึ่งก็คือการทำ 3D Print เส้นไหม โดยการทำชิ้นส่วนโมเดลที่ต้องการออกมาก่อน แล้วแบ่งส่วนให้ตัวไหมเกาะเพื่อที่จะได้พ่นไยใส่บริเวณนั้น และเมื่อนำมาประกอบกันก็ได้จะโมเดลที่ทำจากเส้นใยไหมล้วนๆ (ยังงี้ก็ได้หรอ)

หรือจะเป็นแนวกราฟิกแบบสุดๆ ก็จะมีการทำ simulation ของหยดน้ำบนผิวกันน้ำหรือผิวซึมได้, การปรับปรุงการเรนเดอร์ภาพ, การปรับปรุงการแสดงผลเงาของวัตถุ เป็นต้นครับ

Exhibition

บริเวณแรกที่เดินเข้าฮอลล์ไปชมจะเป็นส่วนที่บริษัทต่างๆ ขนผลงานมาโชว์กันครับ ผมก็เดินผ่านมาเจอ Yannix บริษัทไทยที่ทำงานพวก Visual Effect ให้หนังหลายเรื่อง จากที่ยืนดูเค้าโชว์อยู๋ก็มีส่วนร่วมในหนังดังอย่าง Deadpool ด้วย และยังมีผลงานที่ทำเอฟเฟกต์ประกอบพวกซีรีส์ด้วยครับ และข้างๆ ก็มีหุ่นยนต์ต้อนรับที่พัฒนาโดยทีมจาก มหาวิทยาลัยเทคโนโลยีพระจอมเกล้าธนบุรี มาโชว์ด้วย

ใกล้ๆ กันมีบูธจาก Ritsumeikan University จากญี่ปุ่นที่มีผลงานทั้งเกา้อี้วีลแชร์ที่เมื่อมีการเคลื่อนที่หรือหมุนล้อจะเหมือนการคุมเพลงของดีเจ ทางทีมบอกว่าเป็นผลงานทำสนุกๆ แต่ก็มองว่าเป็นการสื่ออารมณ์ของผู้ใช้งานวีลแชร์ได้ด้วย ในบูธเดียวกันก็มีผลงานเป็นการสร้างระบบนิเวศจำลองที่มีสัตว์ 3 สายพันธุ์ไล่ล่าเป็นห่วงโซ่ เห็นว่าออกแบบมาเพื่อให้เป็น Interactive Learning เข้าไปทดลองใช้กับเด็กประถมที่ญี่ปุ่นครับ

เดินๆ ไปอีกหน่อยผมก็เจองานที่น่าสนใจอีกตัวนึงครับ มาจากทาง Fujitsu ประเทศญี่ปุ่นโดยได้นำแว่น AR/Mixed Reality ชื่อว่า MOVERIO ที่พัฒนาโดย Epson มาร่วมกับระบบของ Fujitsu เพื่อสร้างเป็นแว่นแปลภาษาครับ

โดยการสาธิตที่ทำให้ดูคือเค้าจะพูดภาษาญี่ปุ่น คนใส่แว่นจะเห็นตัวหนังสือสีเขียวๆ อยู่กลางหน้าจอบนแว่น ขึ้นมาเป็นภาษาอังกฤษตามคำที่ได้ยินมา การแปลยังไม่ได้สละสลวยนักครับแต่ก็ทำออกมาได้ค่อนข้างเร็วดี และยังสามารถใช้แบบปิดหน้าแว่นให้เห็นชัดๆ หรือเปิดเป็นแบบ AR ก็ได้เช่นกัน แนวคิดที่เค้านำเสนอคืออาจจะนำไปพัฒนาใช้กับการชมหนังได้ (แต่ผมว่าน่าจะต้องปรับอีกพอตัวเพราะเสียงในโรงหนังน่าจะตีกันพอควรทั้งซาวด์ประกอบและเสียงพูด)

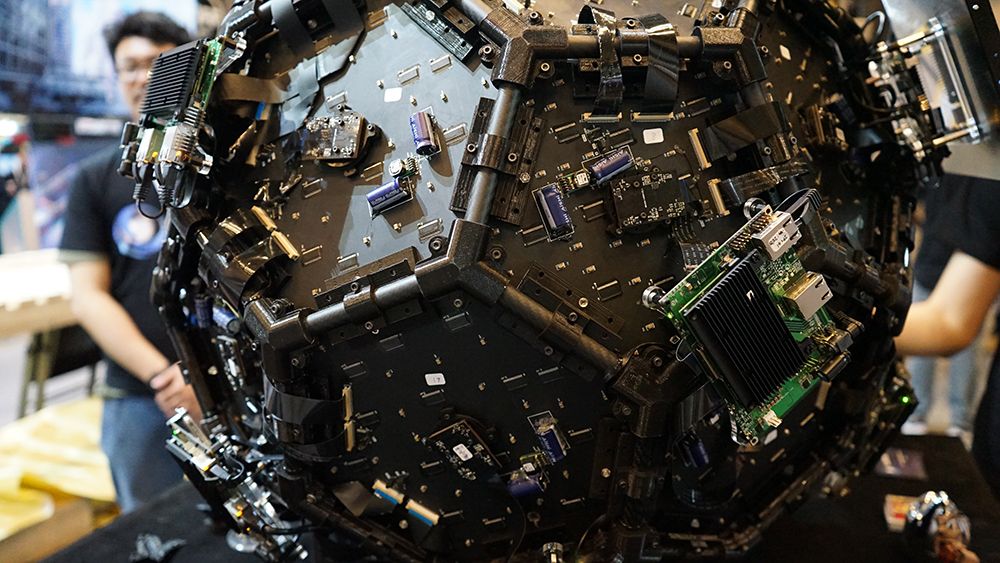

มาอีกนิดนึงก็เจอกับบูธของ Lumio 3D ครับ โดดเด่นทีเดียวเพราะว่าสิ่งที่เค้านำเสนอเป็นเครื่องจัดกลมๆ ขนาดใหญ่พอตัว มันคือเครื่องสแกนโมเดล 3 มิตินั่นเอง บริษัท Lumio 3D นี่ก็เป็นอีกหนึ่งบริษัทของคนไทยครับ โดยจุดเด่นที่เครื่องของเค้าทำได้ก็คือสามารถสแกนโมเดลที่มีความแวววาวอย่างโลหะ, พระเครื่อง หรือพวกเครื่องประดับก็ได้ครับ

ตัวเครื่องมีทรงเป็นโดมสีดำๆ และมีแผงวงจรอยู่เต็ม และเข้าใจว่าใช้ Arduino ในการทำงานครับ มองผ่านๆ นี่เหมือนกับวัตถุจากต่างดาวตามหนังไซไฟเลย

Emerging Technologies

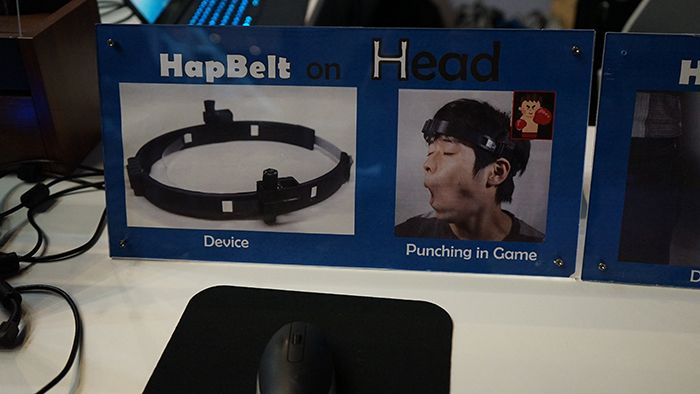

อีกโซนที่ผมเดินไปดูก็คือ Emerging Technologies เป็นพวกเทคโนโลยีแปลกใหม่ แต่ส่วนใหญ่ก็จะออกไปทาง Immersive Tech ที่ให้ความสมจริงในการสร้างสัมผัสต่างๆ ครับ บูธแรกที่ผมเจอเลยก็เป็น HapBelt ที่สร้าง Haptic Feedback ให้สัมผัสเสมือนว่าเรากระทำหรือโดนกระทำอะไรบางอย่างจริง โดยที่บูธสาธิตจะมีทั้งนำ HapBelt มาติดที่หัวให้ความรู้สึกเหมือนกับเราโดนคนชก (รู้สึกจริงเหมือนโดนผลักๆ ดันๆ มากกว่า เค้าคงไม่อยากทำแรงด้วย ฮ่าๆ) หรือสามารถใช้เหมือนโดนดึงแขนสำหรับการนำทางก็ได้ครับ

ใกล้ๆ กันก็มีการเอาเครื่องปล่อยคลื่น Radar มาอ่านค่าพื้นผิวอุปกรณ์ต่างๆ แล้วสร้าง Neural Network ให้แยกแยกประเภทของได้ด้วยครับ แม้จะเป้นของใกล้เคียงกันก็แยกได้ มีการยกเอา Nexus 5 กับ Galaxy Note 3 มาวางเทียบให้ดูด้วยว่ามันแยกได้ ระหว่างดูอยู่ก็มีคนถามเจ้าของผลงานว่าสามารถใช้ในการตรวจคุณภาพสอบอาหารได้มั้ย ก็เลยทราบว่าจุดด้อยของ Radar คือมันผ่านพวกน้ำได้ดี อาหารที่ส่วนใหญ่มีน้ำเป็นองค์ประกอบอาจจะเอาไปใช้ได้ยากอยู่

^ ในภาพเป็นแปรงลบกระดานครับ

บูธนึงที่ผมไปลองเล่นแล้วประทับใจมากคือการเอา VR มาหลอกการรับรู้ของเราครับ มีการเอาการเคลื่อนที่ของเราไปประมวลผลและสร้างภาพจำลองใน VR มาหลอกเราให้รับรู้ตามใน VR ผมหาไม่เจอว่าชื่องานวิจัยชื่ออะไร แต่ถ้าจำไม่ผิดเป็นทีมจากมหาวิทยาลัยโตเกียวครับ โดยเค้าจะให้ลองใส่ HTC Vive กับถุงมือที่มีตัวเซนเซอร์บอกตำแหน่งมืออยู่ ในห้องที่เล่นจะมีโต๊ะ 4 เหลี่ยมจัตุรัสอยู่ตัวนึง

เมื่อเราใส่แว่นก็จะมีโต๊ะในตำแหน่งเดียวกันอยู่ เค้าจะให้เราจับๆ คลำๆ ขอบโต๊ะไปรอบนึง แล้วจะเปลี่ยนภาพใน VR กลายเป็น 3 เหลี่ยม แล้วให้เราคลำต่อ แม้เราจะรู้ว่าโต๊ะจริงๆ มันเป็น 4 เหลี่ยม แต่พอคลำๆ ไปก็รู้สึกว่า เอ้ย มันก็เป็น 3 เหลี่ยมว่ะ แล้วพอครบรอบก็เปลี่ยนเป็น 5 เหลี่ยม ซึ่งจากการลองมาพบว่ามันหลอกเราได้หมดเลยด้วยภาพใน VR ถือว่าเจ๋งดีครับ

คล้ายๆ กันก็มี VR ที่ทำให้เรารู้สึกว่าแขนเรายืดได้ด้วย จากที่สอบถามคนเล่นมาก็บอกกันว่ามันรู้สึกเหมือนยืดออกไปจริงๆ

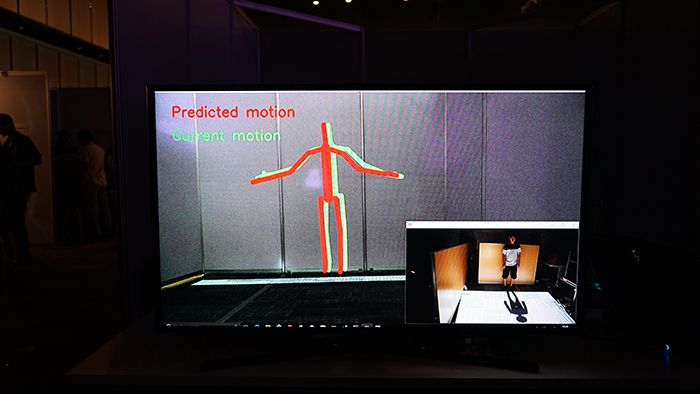

เทคโนโลยีอื่นๆ ที่ผมเดินเจอก็มีการเอา Kinect มาวิเคราะห์ท่าทางของเราแล้วเดาว่าเราจะเคลื่อนที่ไปในทางไหน จากการสาธิตคือการกระโดดไปข้างๆ เส้นแดงๆ ในจอคือการคาดเดาตำแหน่ง ซึ่งพอมันดูท่าทางเราแล้วน่าจะไปซ้ายหรือขวา เส้นก็จะกระโดดไปรอแล้ว ค่อนข้างแม่นอยู่ครับสำหรับการกระโดดที่เค้าทำให้ดู

อีกอันที่น่าสนใจดีก็คือการใช้ Refresh rate ของจอมาสร้างภาพลายน้ำเพื่อก่อนกับกล้องถ่ายภาพ โดยดักความเร็วชัตเตอร์เอาไว้ให้ไม่สามารถถ่ายภาพผลงานได้ เพราะจะมีลายน้ำวิ่งขึ้นมาบังตลอด ดูตัวอย่างภาพที่ผมพยายามถ่ายมาได้ครับ

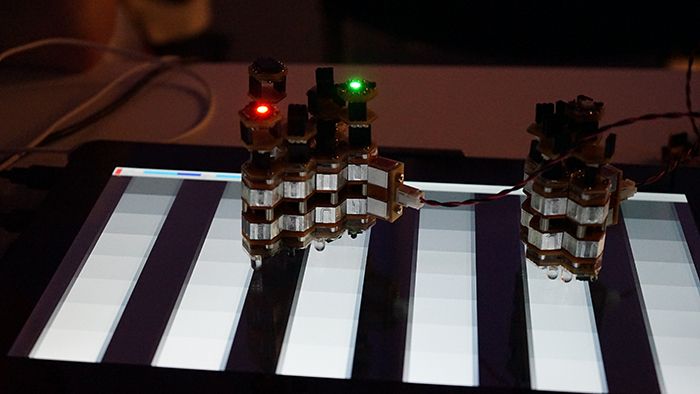

หันมาข้างๆ ก็จะเห็นกับของแปลกๆ ที่เรียกว่า OptRod ครับ เป็นโปรโตไทป์ของอุปกรณ์ที่รับอินพุทเป็นแสง/ภาพจากหน้าจอคอมหรือโปรเจคเตอร์ผ่านด้านล่างของมัน เพื่อไปสั่งงาน Actuator หรือส่วนประมวลผลด้านบน ตัวที่เอามาโชว์นั้นจะเล่นเสียงครับ พอภาพบนจอเปลี่ยนไปก็จะส่งเสียงออกมา จุดเด่นคือการออกแบบที่รอบตัวเป็น 6 เหลี่ยมทำให้ประกอบกันเป็นแผงได้ และออกแบบให้ในอนาคตอาจจะเปลี่ยนเป็นไฟ LED หรือเป็นการทำงานอื่นๆ ได้เช่นกัน

Art Galleries

ส่วนสุดท้ายที่เดินชมมาคือการแสดงผลงานศิลปะครับ จุดเด่นที่แตกต่างจากงานศิลปะทั่วไปคือทุกผลงานจะมีกลไกเข้ามาเกี่ยว บางผลงานก็เป็นแบบ Interactive ที่ให้ผู้ชมมีส่วนรวมหรือเล่นได้

บูธแรกที่ผมเดินมาเจอเป็นบูธของ Bit Studio บริษัทสัญชาติไทยอีกเจ้าหนึ่ง โดยได้เอาผลงานชื่อว่า (A)I Feel มาโชว์ ผู้ชมสามารถร่วมวาดหน้าตาหรือความรู้สึกลงบนตอแล้วภาพนั้นจะถูกนำไปฉายบนฉากและสร้างก๊อปปี้ขึ้นมาไหลลงสู่กองลูกบอลบนพื้นและไหลไปมาคล้ายน้ำ และเมื่อคนเข้าไปเดินในกองลูกบอล ภาพที่อยู่บนพื้นก็จะวิ่งเข้าหาตัวคนได้ด้วยครับ

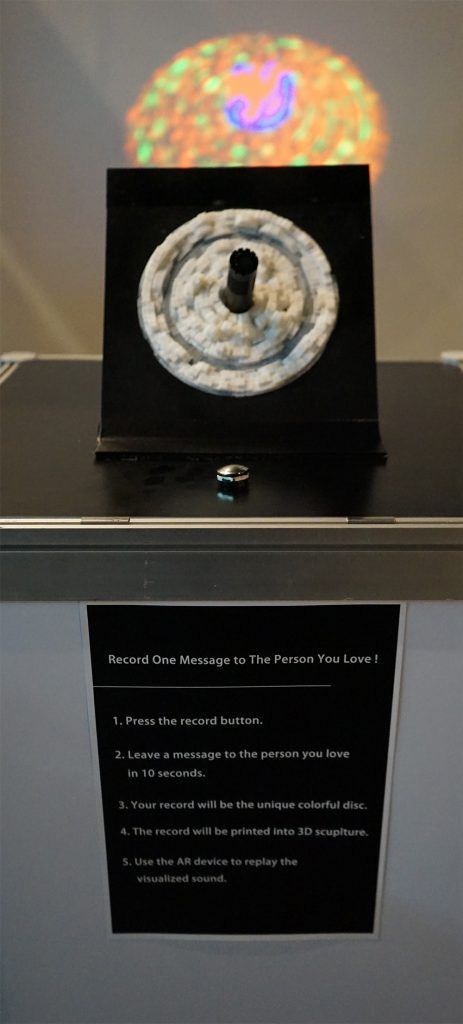

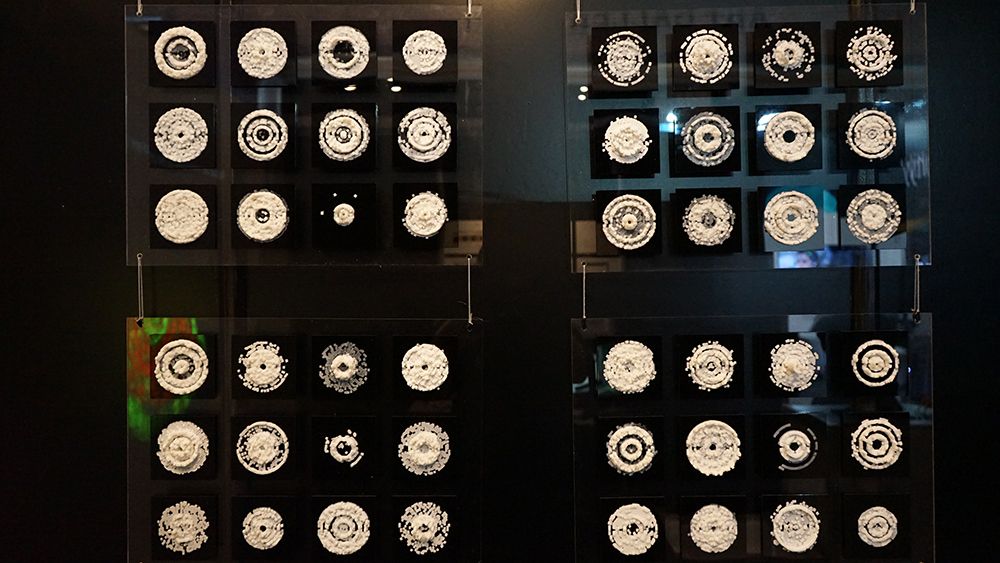

ตรงข้ามกันก็จะมีผลงานที่ให้เราบันทึกเสียงใส่ไมค์ แล้วจะถูกนำมาสร้างเป็นโมเดล 3 มิติคล้ายๆ แผ่นวงกลม แต่มีความหยักและมีพื้นผิวที่ไม่เรียบ ขึ้นกับเสียงที่รับเข้าไป และเมื่อนำโมเดลที่ได้มาไปทำ 3D Print ออกมาก็จะสามารถเอาโปรแกรม AR ของเค้าไปส่องและฟังเสียงที่บันทึกได้ ดูล้ำๆ ดีครับ แต่ก็แอบหลอนๆ เพราะหยิบคอมเค้าไปส่องแล้วก็มีเสียงคนออกมา เหมือนอ่านความจำความนึกคิดในอดีตของเค้าได้ ฮ่าๆ

ใกล้ๆ กันก็มีบูธนึงที่เตะตาผมมากๆ เพราะว่ามีหลอดไฟห้อยอยู่ ดูโล่งๆ พอไปเดินดูถึงพบว่าเป็นหลอดไฟ กับลูกเหล็กบนพื้น และเป็นผลงานที่โชว์การสร้างเงาเลียนแบบที่มีปฏิสัมพันธ์ด้วยได้

จากวิดีโอจะเห็นว่าพอหลอดไฟแกว่งซ้ายขวา เงาที่ถูกสร้างจะเปลี่ยนจากเหลี่ยมๆ ไปสู่ผิวกลมเกลี้ยงๆ และบางจังหวะจะมีเงาเสริมขึ้นมาเหมือนมีหู คล้ายๆ หูตุ๊กตาหมี เค้าบอกว่าเป็นเวลาที่แสดงอารมณ์ว่าดีใจหรือมีความสุขครับ และถ้าเราเดินเข้าไปใกล้ๆ ชู 2 แขนทำท่าหลอกมันก็มีโอกาสที่ผิวของเงาจะมีแท่งแหลมๆ โผล่ขึ้นมาแสดงว่ามันตกใจได้ด้วยครับ ดูเรียบๆ แต่ก็เจ๋งดี

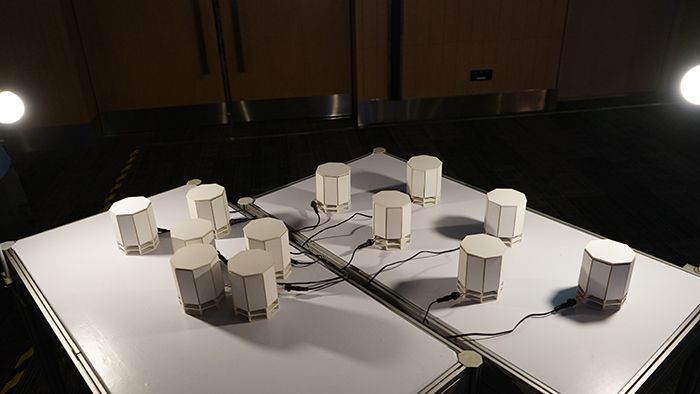

ผลงานติสท์ๆ หรือที่ดูแล้วไม่ค่อยเข้าใจก็มีครับเช่น etheroid เป็นอุปกรณ์คล้ายๆ ทรงกระบอก โดยแต่ละอันทำงานด้วยตัวมันเอง ทำหน้าที่เหมือนสื่อกลางในการส่ง “อะไรบางอย่าง” เค้าอธิบายว่าถ้าเอา etheroid ตัวใหม่มาวางมันก็จะรับข้อมูลจากตัวใกล้ๆ แล้วส่งต่อข้อมูลให้กัน

ในงานมีผลงาจากจากญี่ปุ่นมาเยอะพอสมควรครับ ผมเดินมาอีกหน่อยก็เจอกล่องลูกบาศก์ที่ประกอบด้วยหลอดไฟลูกบาศก์ข้างในตั้งอยู่ เป็นงานที่เลียนแบบการแสดงผลภาพแบบพิกเซลโดยทำมาเป็นขนาด 7 x 7 พิกเซล และจะแสดงตัวอักษรญี่ปุ่นจนครบประโยค พอครบมันจะหมุนแล้วแสดงประโยคถัดไปครับ ดูแล้วเก๋ๆ เอามาตั้งตามบ้านได้เลย

ตัวลูกบาศก์ จริงๆ ผมลองมาว่าเอากล้องปรับ Brightness ต่ำๆ จะอ่านง่ายขึ้นเยอะเลย

อันนี้ข้อมูลประโยคแต่ละประโยคที่เค้าอธิบายไว้ครับ

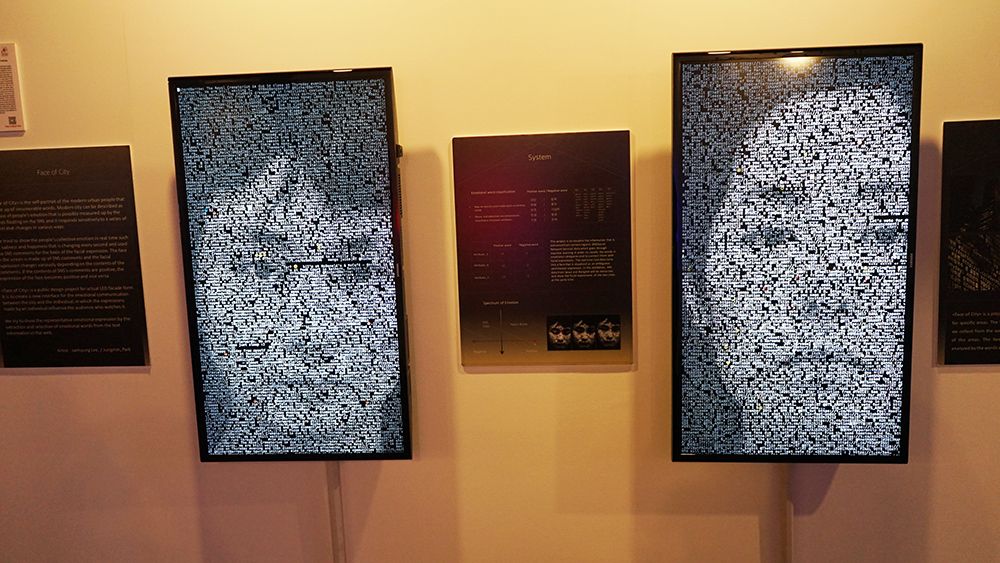

ห่างมาไม่มาก็มีผลงานที่มองไกลๆ เราจะเห็นเป็นใบ้หน้าของคนแสดงสีหน้าอารมณ์ดูเศร้าๆ แต่พอเข้าไปดูใกล้ๆ ก็พบว่าเป็นภาพใบหน้าที่สร้างจากตัวหนังสือ งานนี้ชื่อว่า Face of City ที่นำข้อมูลข้อความจากพวกโซเชียลมาวิเคราะห์ความรู้สึก-อารมณ์ ว่าเป็นแง่บวกหรือแง่ลบ และใบหน้าที่แสดงนั้นก็จะปรับไปตาม ถ้าคนพูดบวกเยอะก็จะเป็นใบหน้ายิ้มแย้มมีความสุข แต่ถ้าข้อความส่วนใหญ่เป็นแง่ลบก็จะเป็นใบหน้าเศร้า เรียกได้ว่าได้ทั้งอาร์ตและสะท้อนความรู้สึกคนในเมืองได้พร้อมๆ กันเลย

อันสุดท้ายที่ผมเห็นว่าดูแปลกตาก็เลยเดินเข้าไปดูคือผลงานชื่อว่า Hive ที่เป็นโมเดลสร้างขึ้นมาเหมือนรังของเอเลี่ยนทำนองนั้น และแต่ละรูของรังนี้จะมีลำโพงสลับกับไมโครโฟน ตัวไมโครโฟนจะรับเสียงภายนอกไปและมีการสร้างเสียงตอบรับออกมาผ่านลำโพง และด้วยการที่ไมโครโฟนหลายตัวก็ทำให้สามารถส่งเสียงออกไปถูกตำแหน่งกับที่คนทำเสียงใส่ไป เสียงสังเคราะห์ทำมาได้หลอนๆ เหมือนหนังเอเลี่ยนเลยครับ ฮ่าๆ

สำหรับงาน SIGGRAPH Asia 2017 นั้นจัดถึงวันที่ 30 พฤศจิกายนนี้ครับ กระชั้นชิดไปหน่อยสำหรับข่าวนี้ ถ้าใครสนใจและสะดวกเดินไปทางไปชมก็ยังไปวันพรุ่งนี้ได้อีกวันนึงครับ ถือเป็นการที่เอาเทคโนโลยีมานำเสนอได้น่าสนใจทีเดียวครับ และยังมีงานวิจัยล้ำๆ มาให้ชมกันอีกด้วยครับ

Comment