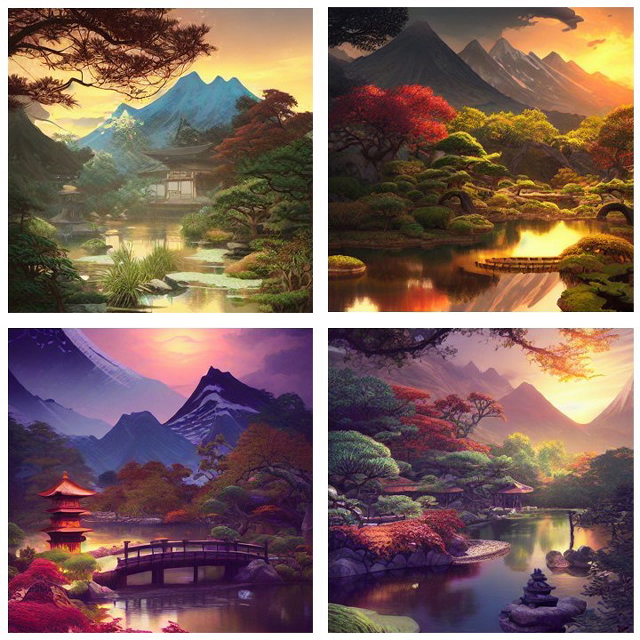

Qualcomm โชว์การปรับแต่งโมเดล Stable Diffusion ให้รันบนมือถือ Android ได้แล้วเป็นครั้งแรกของโลก ซึ่งทุกคนน่าจะได้ยินกันมาบ้างสำหรับ Stable Diffusion เป็นหนึ่งใน AI ปัญญาประดิษฐ์ชื่อดังที่สามารถวาดภาพได้ตามข้อความที่ถูกป้อนให้มันเช่นเดียวกับ DALL-E และ Midjourney นั่นเอง ล่าสุดสามารถพัฒนาให้มือถือที่ใช้ชิป Snapdragon 8 Gen 2 รันบนมือถือ Android ได้แทนการใช้บนคลาวด์แล้ว!

โดยพื้นฐานแล้วการใช้ข้อมูลจากปัญญาประดิษฐ์ ต้องใช้ชุดข้อมูลมากมากมายมหาศาล ทาง Qualcomm ยังบอกเพิ่มเติมว่า Stable Diffusion เป็นโมเดลขนาดใหญ่ที่มี พารามิเตอร์เกิน 1 พันล้านตัว ปกติแล้วจะใช้งานได้แค่การรันบนคลาวด์เท่านั้น

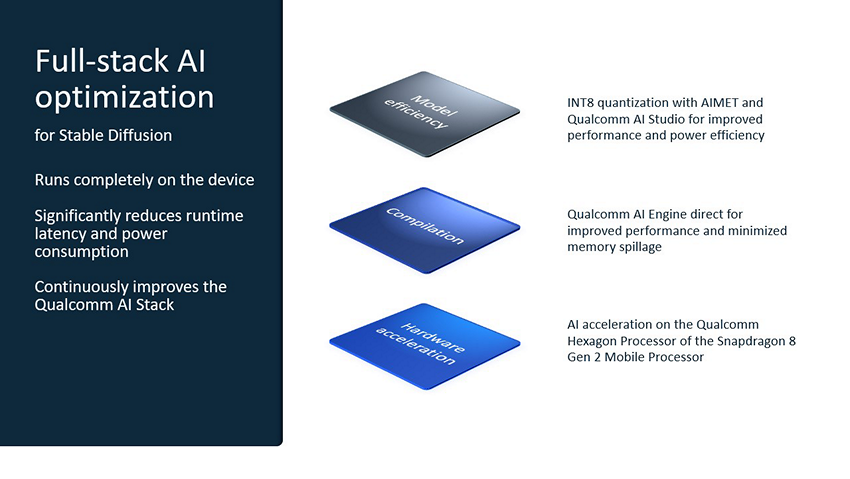

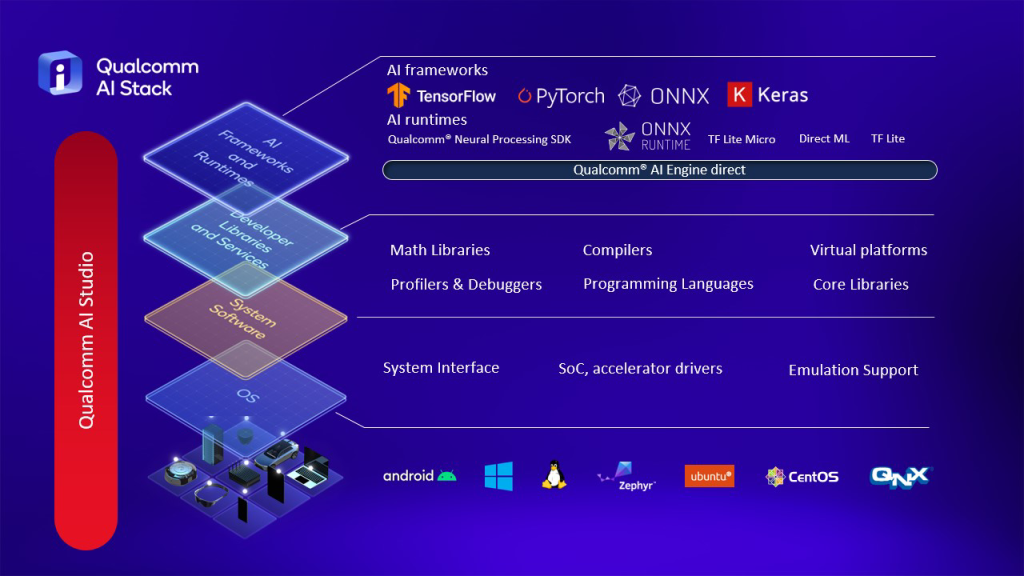

ทีมนักวิจัยของ Qualcomm AI Research ได้ทำการทดลองอะไรหลายอย่างให้เหมาะสมทั่วทั้งแอปพลิเคชัน ประกอบไปด้วย neural network model, algorithms , software และ hardware โดยใช้เทคนิครีดประสิทธิภาพหลายอย่างร่วมกันให้สามารถรันบนมือถือได้ มีดังนี้

- การแปลงฟอร์แมตตัวเลข FP32 เป็น INT8 เพื่อลดขนาดของโมเดลลง โดยยังรักษาระดับความแม่นยำ และไม่ต้องเทรนโมเดลใหม่ (post-training quantization)

- การแมป neural network ของโมเดลให้เหมาะกับสถาปัตยกรรมฮาร์ดแวร์ โดยเฉพาะลำดับชั้นหน่วยความจำของ Qualcomm Hexagon Processor ผ่าน Qualcomm AI Engine

- การเร่งประสิทธิภาพที่ระดับฮาร์ดแวร์ ผ่านฟีเจอร์ micro tile inferencing ของ Snapdragon 8 Gen 2 ช่วยให้โมเดลขนาดใหญ่อย่าง Stable Diffusion ทำงานได้อย่างมีประสิทธิภาพ

เนื่องจากการปรับแต่งทั้งหมดเข้าด้วยกัน ทำให้มือถือสามารถทำงานบน Stable Diffusion ได้ด้วยความละเอียดภาพ 512×512 พิกเซล ตาม inference 20 ขั้นภายในระยะเวลา 15 วินาที

นี่ก็นับเป็นอีกหนึ่งความก้าวหน้าของเทคโนโลยี Edge AI หรือเรียกง่าย ๆ ว่าเป็นการนำเอาแอปพลิเคชัน AI ใส่เข้าไปในอุปกรณ์ต่าง ๆ ที่ใช้งานกันในโลกความเป็นจริงใกล้กับจุดที่จัดเก็บข้อมูล แทนที่การวางไว้อยู่บน Cloud Computing หรือว่า Data Center อย่างที่ทำกันมาในยุคก่อน ๆ นั่นเองค่ะ

และการประมวลผลของ AI ในเครื่องปลายทางทำให้เกิดข้อดีทั้งเรื่องระยะเวลา latency ของอินพุตทำให้สามารถวิเคราะห์ข้อมูลได้แบบ Real Time , ลดต้นทุนค่าประมวลผลคลาวด์, และความเป็นส่วนตัวเพราะข้อมูลไม่ต้องออกจากเครื่องเลยด้วยซ้ำ แถมยังเรียนรู้ข้อมูลใหม่ ๆ ได้ต่อเนื่องด้วย

ที่มา : Qualcomm

Comment